Tous vos outils, connectés en quelques clics

TALKR s'intègre nativement à l'ensemble de votre stack technologique. CRM, automation, messaging, téléphonie — chaque connecteur est préconfiguré et prêt à l'emploi.

+100 connecteurs natifs dans une interface unifiée

CRM, téléphonie, messaging, paiement, LLM — tout votre écosystème orchestré visuellement depuis la plateforme TALKR.

CRM / ERP

Synchronisez vos contacts, enrichissez vos fiches clients et créez des tickets automatiquement depuis vos agents IA.

Automation & No-code

Déclenchez vos scénarios d'automation depuis vos agents IA. Webhooks entrants et sortants, workflows multi-étapes, aucune limite à l'imagination.

En règle générale, plus de 90 % de la logique est exécutée directement dans TALKR — sans outil externe. Mais pour certains scénarios avancés (enrichissement multi-sources, orchestration CRM complexe, synchronisation interne), TALKR se connecte nativement à Make et n8n. Le meilleur des deux mondes : la simplicité no-code de TALKR pour 90 % des cas, et la flexibilité illimitée de Make/n8n pour les 10 % restants.

Messaging & Canaux digitaux

Déployez vos agents IA sur tous les canaux de messagerie instantanée. Une seule plateforme pour gérer WhatsApp, Instagram, Teams et bien d'autres.

💡 Connexion possible aussi avec l'API de TALKR directement dans vos interfaces et votre propre CSS — ou votre cafetière à café :)

Téléphonie & CCaaS

Branchez vos agents vocaux IA sur votre infrastructure téléphonique existante. Compatible avec les principaux opérateurs et plateformes CCaaS du marché.

💡 Le saviez-vous ? Aucun de ces opérateurs n'avait intégré d'agent IA dans son fonctionnement avant 2025 — hormis Genesys et Twilio !

Brancher un SIP Trunk avec TALKR, c'est simple

Votre propre SIP Trunk fourni par TALKR. Aucune configuration tierce nécessaire — bénéficiez d'un trunk SIP intégré nativement à la plateforme, avec numéros DID français et internationaux, qualité HD et facturation unifiée directement depuis votre compte TALKR.

Pour connecter votre infrastructure téléphonique existante, il nous faut :

- 📡 L'adresse IP de votre trunk SIP

- 🔑 Un login et un mot de passe d'authentification

- 🔒 Les ports sécurisés — en général le port 5060, en mode TLS ou UDP

- ✅ Whitelister nos adresses IP (carriers TALKR) côté pare-feu

🎧 Nos spécialistes Téléphonie sont là pour installer vos trunks — de la configuration initiale à la mise en production, on vous accompagne à chaque étape.

Contacter notre équipe Téléphonie →Moteurs Vocaux & Synthèse

Choisissez la voix de vos agents parmi les meilleures technologies de synthèse vocale et de reconnaissance de la parole disponibles sur le marché.

🎯 Le bon compromis : 5 critères à équilibrer

Chaque moteur vocal a ses forces. Le choix idéal dépend de votre cas d'usage — survolez chaque critère pour comprendre les enjeux.

👆 Survolez un critère pour découvrir les enjeux

Ticketing & Support

Créez, qualifiez et routez vos tickets support automatiquement depuis vos agents IA. Réduisez le temps de traitement et améliorez la satisfaction client.

TALKR intègre nativement son propre système de ticketing — créez, qualifiez et suivez vos tickets directement depuis la plateforme, sans outil tiers. Et si vous utilisez déjà un autre outil, notre connecteur API universel permet de l'intégrer en moins d'1 heure.

TALKR intègre déjà la solution. Grâce à nos applications no-code, visualisez, lisez et gérez vos tickets et demandes directement depuis la plateforme — sans effort, sans outil supplémentaire.

Paiement sécurisé

Encaissez vos clients directement pendant les appels ou conversations — sans redirection, sans friction, en toute sécurité PCI-DSS.

CMS & Sites web

Intégrez un agent IA conversationnel directement sur votre site web en quelques lignes de code — compatible avec tous les CMS du marché.

API Custom — Connecteur Universel

Votre outil n'est pas dans la liste ? Aucun problème. TALKR intègre toute API JSON REST en moins d'1 heure grâce à notre connecteur universel no-code. Configurez vos appels API, définissez les paramètres à envoyer et les données à récupérer — directement depuis l'éditeur visuel. ERP maison, base de données interne, API propriétaire : si votre système a une API, TALKR peut s'y connecter.

Comment ça marche concrètement ?

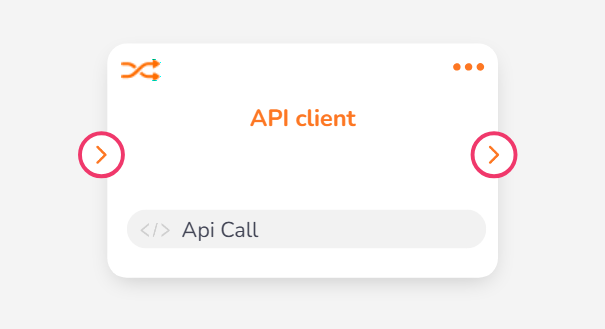

Glissez un bloc « API Client » dans votre flow, configurez-le en quelques clics — c'est tout.

Étape 1 : Glissez le bloc « API Client » dans votre scénario. Les ports d'entrée/sortie se connectent au reste de votre flow conversationnel.

Étape 2 : Renseignez l'URL, la méthode, le body avec vos variables dynamiques ([CALLER], [RESPONSE]…). Mappez les données de retour. Aucune ligne de code.