Depuis leur création, les technologies de traitement du langage naturel ont connu une évolution fulgurante. Ces dernières années, l’une des innovations les plus marquantes dans ce domaine est le modèle de langage de l’IA GPT (Generative Pre-trained Transformer), qui a rapidement été adopté par un grand nombre d’entreprises et de chercheurs. Dans cet article, nous allons examiner les raisons pour lesquelles GPT a été adopté de manière si rapide et pourquoi il est devenu l’un des modèles les plus populaires.

voici une liste des raisons pour lesquelles GPT a été adopté de manière fulgurante malgré certaines limites :

- Performance de pointe : GPT est capable de produire des résultats de pointe dans diverses tâches de traitement du langage naturel, notamment la génération de texte, la classification de texte, la traduction de texte et la réponse à des questions. Cette performance impressionnante a contribué à la popularité rapide de GPT.

- Pré-entraînement efficace : Le modèle GPT est pré-entraîné sur de vastes quantités de données non annotées, ce qui lui permet de généraliser de manière efficace à des tâches spécifiques avec un nombre relativement faible d’exemples d’entraînement. Cela signifie que les utilisateurs peuvent entraîner un modèle GPT pour une tâche spécifique avec moins d’exemples d’entraînement que les autres modèles de traitement du langage naturel.

- Facilité d’utilisation : GPT est relativement facile à utiliser par rapport à d’autres modèles de traitement du langage naturel, grâce à l’utilisation d’une architecture de transformer simple. Cela permet aux utilisateurs de s’entraîner sur leurs propres données avec moins de complexité.

- Large communauté de développeurs : GPT est soutenu par une grande communauté de développeurs, qui ont travaillé à son amélioration et à sa documentation. Cela a rendu l’apprentissage de l’utilisation de GPT plus facile et plus accessible à un plus grand nombre de personnes.

- Flexibilité : GPT peut être utilisé pour une variété de tâches de traitement du langage naturel, ce qui le rend polyvalent et adapté à de nombreux domaines différents. Cette flexibilité a contribué à son adoption rapide par des entreprises et des chercheurs de différentes industries.

Malgré ses avantages, GPT a aussi des limites, notamment en ce qui concerne la compréhension des nuances et des subtilités du langage, ainsi que sa tendance à reproduire des stéréotypes et des biais présents dans les données d’entraînement. Cependant, la facilité d’utilisation, la performance de pointe et la flexibilité de GPT continuent de le rendre attrayant pour un grand nombre d’utilisateurs.

La prochaine version de GPT, appelée GPT-4, devrait être encore plus puissante que ses prédécesseurs pour plusieurs raisons. Voici quelques-unes des raisons pour lesquelles GPT-4 sera plus puissant :

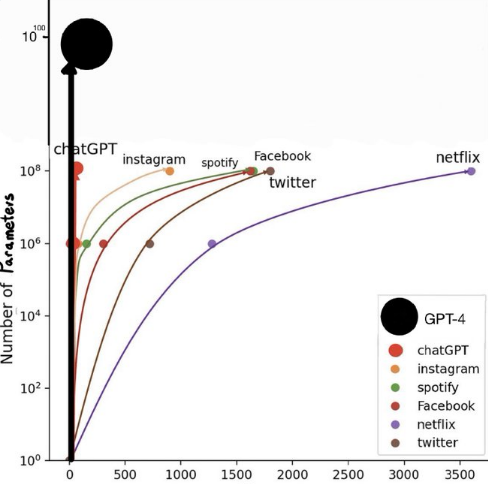

- Taille accrue du modèle : Les modèles GPT sont pré-entraînés sur de vastes quantités de données non annotées. La prochaine version de GPT, GPT-4, devrait avoir une taille de modèle beaucoup plus grande que les versions précédentes, avec probablement des centaines de milliards de paramètres. Cette taille accrue du modèle devrait améliorer sa capacité à comprendre les relations complexes entre les mots et les phrases, ce qui se traduira par une meilleure performance dans les tâches de traitement du langage naturel.

- Amélioration de la qualité des données d’entraînement : GPT-4 bénéficiera de l’utilisation de données d’entraînement plus diverses et de meilleure qualité. Cela permettra au modèle de mieux généraliser à des tâches de traitement du langage naturel plus complexes et de mieux représenter la diversité du langage humain.

- Amélioration de l’architecture : GPT-4 devrait bénéficier d’améliorations de l’architecture de l’IA, qui rendront le modèle plus efficace et plus rapide pour l’entraînement et l’inférence. Cela signifie que les utilisateurs pourront entraîner des modèles plus grands et plus précis en moins de temps.

- Intégration de la mémoire à long terme : GPT-4 devrait être capable de conserver des informations à long terme, ce qui permettra de meilleures performances dans des tâches de compréhension de texte et d’analyse de séquences temporelles.

- Utilisation de techniques d’apprentissage plus avancées : GPT-4 devrait intégrer des techniques d’apprentissage plus avancées, telles que le renforcement et l’apprentissage par imitation, pour améliorer ses performances dans certaines tâches de traitement du langage naturel.

En combinant toutes ces améliorations, la prochaine version de GPT devrait offrir une performance encore plus impressionnante dans les tâches de traitement du langage naturel. Cependant, il est important de noter que cela ne résout pas tous les problèmes, tels que la compréhension des nuances et des subtilités du langage et la réduction des biais présents dans les données d’entraînement.